Miles de chats generados por inteligencia artificial están disponibles a través de Google y la Wayback Machine, pese a los intentos por eliminarlos

En plena era de la inteligencia artificial conversacional, la privacidad vuelve a colocarse en el centro del debate. A pesar de las medidas adoptadas por OpenAI para evitar la indexación de conversaciones de ChatGPT compartidas públicamente, estas siguen estando disponibles en buscadores como Google e incluso en la Wayback Machine, una base de datos que archiva páginas web históricas.

La situación ha despertado una profunda preocupación entre usuarios y expertos en privacidad, que ven en este episodio un ejemplo tangible de los riesgos asociados al uso de modelos de lenguaje generativo.

Más de 100.000 chats expuestos en la red

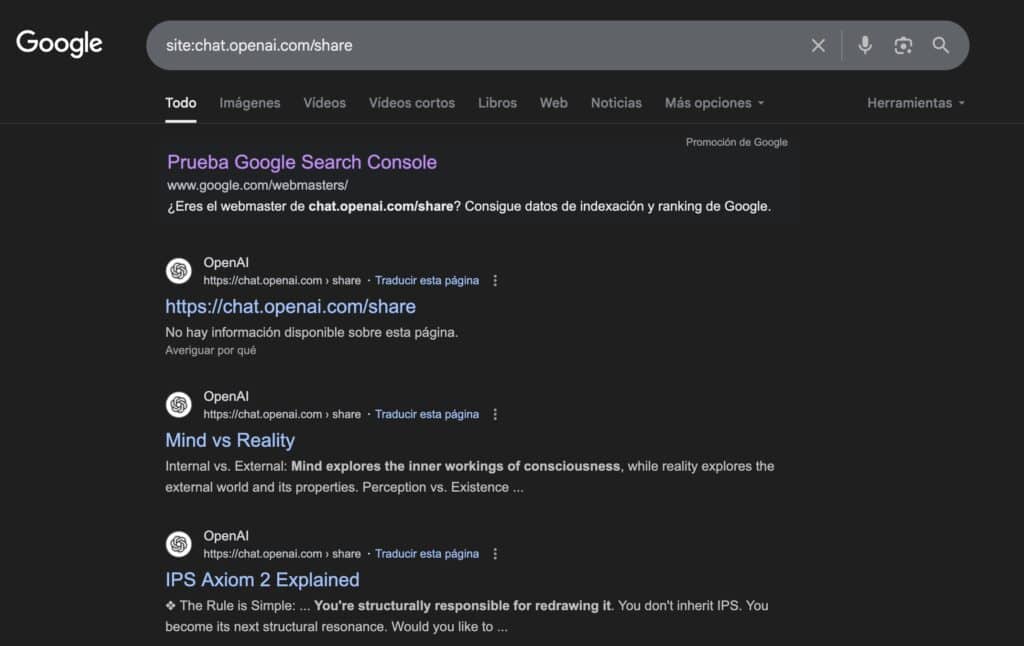

Todo comenzó con un hallazgo inquietante: usuarios de foros y redes sociales detectaron que más de 100.000 conversaciones compartidas a través de la función «share» de ChatGPT eran accesibles mediante simples búsquedas en Google. Las conversaciones, que en muchos casos fueron publicadas intencionadamente, no estaban adecuadamente protegidas frente a la indexación automática de buscadores.

OpenAI reaccionó rápidamente intentando eliminar los enlaces del buscador, pero el problema no termina ahí.

Según el sitio Digital Digging, las conversaciones también han sido archivadas por la Wayback Machine de Archive.org, lo que significa que incluso si OpenAI logra borrarlas de Google, siguen estando disponibles mediante las copias almacenadas en este archivo digital.

Mark Graham, director de la Wayback Machine, fue claro al respecto:

“No hemos recibido ni honrado ninguna solicitud de exclusión a gran escala de URLs del tipo ‘chatgpt.com/share’. Si OpenAI, como titular de los derechos del dominio chatgpt.com, solicitara la exclusión de estas URLs, probablemente la aceptaríamos. Pero hasta ahora, no han hecho tal solicitud.”

En otras palabras, nadie de OpenAI ha pedido formalmente eliminar estas conversaciones del archivo, lo que deja la puerta abierta a que cualquier usuario con conocimientos mínimos pueda acceder a ellas.

¿Qué tipo de información hay en estas conversaciones?

Aunque muchas de las conversaciones compartidas son triviales, otras contienen datos sensibles, ideas personales, preguntas íntimas o incluso temas laborales y legales. El riesgo no es solo reputacional, sino que estas conversaciones pueden ser utilizadas como prueba en juicios, auditorías o investigaciones, abriendo un frente legal para empresas y particulares.

De ahí la advertencia creciente entre especialistas: lo que se dice a un chatbot no siempre se queda en el chatbot.

El caso Grok: otra IA en el punto de mira

El problema no se limita a ChatGPT. El modelo Grok 4, desarrollado por xAI y utilizado en la plataforma X (antes Twitter), también tiene conversaciones visibles en Google. La facilidad para acceder a estos contenidos confirma que los sistemas de IA generativa aún no han resuelto del todo cómo proteger la privacidad del usuario cuando se comparten respuestas públicamente o se almacenan interacciones.

Grok, al igual que ChatGPT, permite compartir respuestas mediante enlaces. Y al igual que OpenAI, parece no haber implementado mecanismos eficaces para evitar que esos enlaces se indexen o se archiven.

¿Qué pueden hacer los usuarios?

Ante este panorama, los expertos recomiendan:

- Evitar compartir públicamente conversaciones de IA que contengan datos personales o confidenciales.

- Leer siempre las políticas de privacidad de las plataformas utilizadas y entender qué ocurre con los datos ingresados.

- Usar versiones autoalojadas o con control local si se requiere confidencialidad real (como algunas implementaciones de PrivateGPT o LLMs open source sin conexión a Internet).

- Y, sobre todo, asumir que todo lo que se publica en la web puede ser almacenado permanentemente.

Reflexión: ¿dónde quedan los derechos digitales?

Este incidente plantea una pregunta fundamental: ¿hasta qué punto están preparadas las grandes tecnológicas para proteger la privacidad de los usuarios en la era de la inteligencia artificial?

La falta de acción por parte de OpenAI en relación con la Wayback Machine es, cuanto menos, sorprendente. Y aunque en muchos casos los usuarios compartieron voluntariamente sus chats, lo hicieron sin conocer el alcance de esa acción.

En un contexto donde la IA conversa, asesora, corrige y acompaña, necesitamos garantías de que nuestras palabras no quedarán flotando en la red eternamente.